Un pirate a recréé la voix d’un dirigeant d’entreprise grâce à l’intelligence artificielle pour piéger un salarié. Une arnaque en vogue particulièrement dangereuse qui, cette fois-ci, n’a pas fait de victime.

L’intelligence artificielle apporte des avancées dans de nombreux domaines comme le jeu vidéo, l’enseignement ou la science. Malheureusement, l’IA conduit souvent à des dérives. Les personnes malintentionnées se servent de l’intelligence artificielle pour créer des deepfakes, de quoi inquiéter les plus réfractaires à cette technologie.

En février dernier, un arnaqueur se faisait passer pour un dirigeant afin de voler 25 millions de dollars à sa victime. Un escroc vient une nouvelle fois de se servir de l’IA pour recréer artificiellement la voix d’un PDG et arnaquer un employé.

Un escroc usurpe l’identité d’un PDG avec l’IA pour tromper un salarié

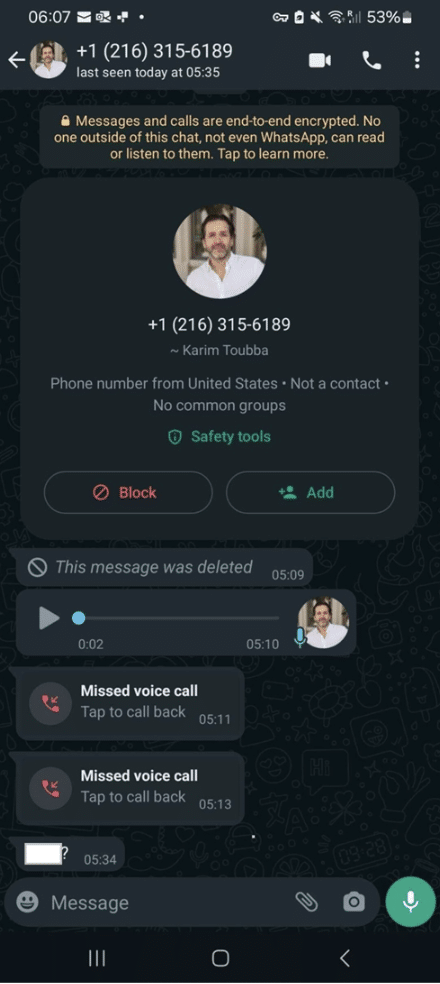

L’entreprise LastPass révèle avoir subi une tentative de deepfake le 10 avril dernier. Un hacker s’est fait passer pour Karim Toubba, le dirigeant du gestionnaire de mots de passe, afin de piéger un salarié de la société.

« Dans notre cas, un employé a reçu une série d’appels, de textos et au moins un message vocal contenant un deepfake audio d’un auteur de menaces se faisant passer pour notre PDG via WhatsApp », détaille LastPass dans son communiqué.

Heureusement, le salarié ne s’est pas laissé berner par l’escroc, malgré l’utilisation de la photo de profil du PDG et ses multiples relances sur WhatsApp. Il a signalé l’incident à l’équipe de sécurité interne de LastPass. L’entreprise ne précise pas ce que l’arnaqueur cherchait à obtenir avec ce deepfake vocal, mais son motif est probablement financier.

Ces tentatives d’escroqueries risquent de se multiplier dans les mois à venir. Un employé pourrait logiquement se laisser piéger, surtout s’il fait partie d’une entreprise modeste, que les arnaqueurs pourraient viser afin de renforcer leur crédibilité.

À lire > Deepfake : il lui vole 600 000 € en se faisant passer pour son ami

LastPass rappelle de vérifier l’identité des contacts potentiellement suspects en utilisant les canaux de communication internes de votre entreprise. Il convient aussi de ne pas réaliser de transactions financières sans avoir pu en discuter de vive voix avec la personne concernée.